Что это такое?

Как можно определить, и в чём различие с другими AI.

Что же обычно подразумевается под Artificial General Intelligence? AGI можно определить как синтетический интеллект, работающий в широком диапазоне задач и обладающий хорошей способностью к обобщению в условиях разных контекстов при выполнения разнородных задач. Другими словами, ИИ, способный выполнять поставленные задачи так же успешно, как человек.

Иерархию AI в данный момент можно представить следующим образом (ранжируя от более простого, к более сложному):

- Artificial Narrow Intelligence (ANI, Narrow AI) – специализируется в одной области, решает одну проблему.

- Artificial General Intelligence (AGI, Strong AI) – способен выполнять большинство из задач, на которые способен человек.

- Artificial Super Intelligence (ASI) – превосходит возможности интеллекта любого из людей, способен решать сложные задачи моментально.

Определение AGI можно проиллюстрировать при сравнении Narrow AI (ANI) и Strong AI (AGI). Стоит заметить, что сейчас не существует ни одной системы, которую можно было бы с уверенностью назвать Strong AI – всё что мы сейчас видим, это AI системы, преуспевающие в выполнении узконаправленных задач: детектирование, распознавание, перевод с одного языка на другой, генерация изображений, генерация текстов, но пока сложно говорить о какой-то универсальности таких моделей и применимости одной модели для выполнения существенно различающихся друг от друга задач без необходимости дополнительной тренировки. Именно применимость одного AI для выполнения вышеперечисленных задач чаще всего называют сильным искусственным интеллектом.

Возвращаясь к разделению на категории, можно обнаружить ещё один термин, который вызывает не меньший интерес, что же это такое. Это Artificial Super Intelligence, возникновение которого предполагается почти следом за созданием AGI (при условии, что AGI умеет обучаться-эволюционировать за счёт модификации самого себя, или создания себе подобных). Если, говоря о AGI, мы говорим о интеллектуальных способностях, близких к человеческим, то суперинтеллект превосходит интеллект человека в разы. Именно вместе с созданием суперинтеллекта предположительно возникает технологическая сингулярность – гипотетический момент, когда наука начинает прогрессировать необозримыми темпами, что приведёт к непредсказуемым последствиям.

Зачем?

Прежде чем бросаться реализовывать подобную систему, искать критерии признания того или иного решения, удовлетворяющего требованиям, стоит прежде всего попытаться понять, что вообще может дать такая разработанная систем, и, в связи с этим, какие задачи она должна уметь выполнять.

В этом, пожалуй, и состоит одна из проблем исследований в этом направлении – они больше напоминают мечту футуриста, без явной привязки к действительной реальности. Какое применение может найти AGI в нашем мире, помимо “везде”? В том плане, какие задачи мы пока не пытаемся решить с помощью ANI? Какое применение в сфере бизнеса могут найти такие модели, если даже не будут достаточно умны?

Для меня прежде всего приходит мысль о способности обобщать, искать и запоминать информацию и делать из неё выводы, таким образом выполняя роль исследователя. Даже возможность искать информацию практически моментально в огромной базе знаний с последующим обобщением в виде набора тезисов-идей может значительно помочь исследователям (отчасти можно связать с термином exploratory search). Не говоря уже о том, что такая система в теории может сама решить сложные задачи, или предложить возможные пути и план, как же достичь решения.

Да, та же самая GPT-3 умеет создавать правдоподобные статьи на различные темы, но, по правде, это остаётся генерацией информации, но не знания. С равным успехом эта система может обосновать два противоположных тезиса, что можно связать с отсутствием критического мышления. В результате такого подхода, армия демагогов может образоваться огромное болото из однообразной информации, в которой будет практически нереально найти действительно новую, важную информацию.

Исходя из подобной проблемы, в качестве первичного этапа развития AGI систем, и целей, которых можно достигнуть, можно выбрать способность систем к обобщению информации с целью выделения из них основных тезисов, отсеивания лишнего и донесения до человека только самого важного

Мировая практика

- В конце марта Италия первой в мире запретила доступ к ChatGPT. Поводом для этого стала утечка персональных данных: из-за сбоя некоторые пользователи чат-бота могли видеть чужие сообщения, а также платежную информацию подписчиков сервиса. В OpenAI, компании-разработчике ChatGPT, заявили, что утечка затронула «крайне малое» число пользователей — 1,2% подписчиков ChatGPT Plus. Однако итальянское Национальное управление по защите персональных данных временно запретило OpenAI обработку персональной информации итальянских пользователей.

- Своим решением Италия создала прецедент: власти Германии заявили, что внимательно следят за решениями итальянских коллег. Профильное ведомство даже запросило у Италии дополнительную информацию о блокировке чат-бота. Федеральный комиссар по защите данных и свободе информации Ульрих Кельбер отметил, что в Германии «в принципе возможен» временный запрет ChatGPT. При этом глава департамента Министерства цифровых технологий Фолькер Виссинг выступил против блокировки. По его словам, Германии нужен не запрет искусственного интеллекта, а инструменты, которые «обеспечат соблюдение норм демократии и прозрачности».

- Против блокировки выступают и власти Индии: Министерство электроники и информационных технологий заявило, что не планирует регулировать развитие ИИ на рынке, поскольку это «стратегически важная» область для страны. В ведомстве считают, что новые технологии положительно влияют на предпринимательство и развитие бизнеса. Более того, правительство будет активно использовать ИИ для оказания гражданам услуг через «цифровые общественные платформы».

Ноябрь: Чат-боты с ИИ и создание видео

В ноябре 2023 года ландшафт искусственного интеллекта стал свидетелем значительных достижений в области чат-ботов с искусственным интеллектом и создания видео. Стартап Илона Маска по ИИ, xAI, представил чат-бота Grok, демонстрирующего потенциал диалоговых агентов, управляемых ИИ, для преобразования отраслей и улучшения взаимодействия с клиентами.

В том же месяце была представлена Pika 1.0 как новая модель для создания видео, демонстрирующая растущее значение искусственного интеллекта в создании контента и цифровых медиа.

Кроме того, StabilityAI выпустила Stable Video Diffusion, инновационное решение для редактирования и генерации видео на основе искусственного интеллекта. Эта разработка продемонстрировала потенциал ИИ для создания визуально привлекательного контента, еще больше трансформируя ландшафт цифровых медиа.

В новостях об искусственном интеллекте, связанных с наукой, был достигнут значительный прогресс: команда исследователей Google DeepMind использовала искусственный интеллект для успешного прогнозирования структуры более двух миллионов новых материалов. Это достижение обладает огромным потенциалом для различных отраслей, включая возобновляемую энергетику и вычислительную технику.

Из 2,2 миллиона предсказанных кристаллических структур DeepMind опубликовал данные о 381 000, которые считаются наиболее стабильными. Это открытие эффективно увеличивает существующую базу данных известных стабильных материалов в десять раз.

Хотя эти материалы по-прежнему требуют синтеза и тщательного тестирования — процесс, который может занять от нескольких месяцев до нескольких лет, — недавний прогресс DeepMind призван ускорить открытие и разработку новых материалов. Эти материалы имеют решающее значение для целого ряда применений, от решений для хранения энергии и солнечных панелей до производства сверхпроводящих чипов.

Нерешённые проблемы

Даже для кажущихся всемогущими компьютерных алгоритмов существуют нерешаемые и плохо решаемые проблемы. В частности, по очевидным причинам сложно решить задачи, трудно поддающиеся формализации, например, «написать роман» или «выбрать самую красивую фотографию». Но даже при наличии математически точной формулировки нет гарантии успешного решения. Причиной этому может быть сложность математического моделирования проблем более низкого уровня (например, моделирование движения при обучении робота играть в футбол), сложность самой проблемы (например, для логического вывода и доказательства математических утверждений нет алгоритмов существенно лучше полного перебора возможных логических цепочек []), огромное количество параметров и неточность наблюдаемого мира (например, при игре в футбол), и недостаточная производительность вычислительных систем по сравнению с человеческим мозгом. В конце концов, взаимодействие 1х1011 человеческих нейронов не поддается алгоритмической симуляции; на начало 2018 года наибольшим успехом в этой области была симуляция 1,7х109 нейронов с 2400-кратным замедлением в 2013 году []; при этом нет уверенности, что симуляция даже нужного количества клеток мозга позволит воссоздать мозговую деятельность в компьютерной модели.

2017 in Review: 10 AI Failures. Google AI looks at rifles and sees helicopters

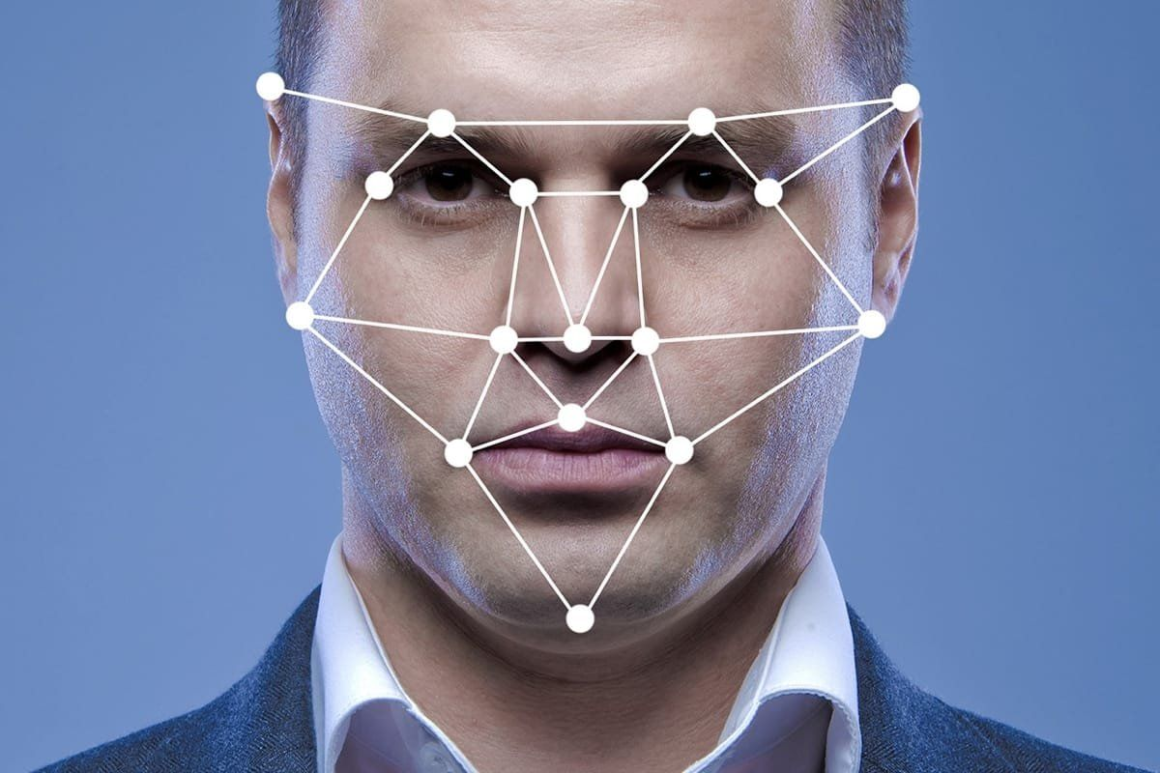

Отдельно стоит упомянуть недостатки машинного обучения. Как правило, машинное обучение предполагает наличие уже классифицированных тренировочных данных, в которых компьютерный алгоритм находит закономерности. Из-за недостаточных данных в работе алгоритма возможны ситуации, когда данные на входе не принадлежат ни к одному из тренированных классов; распознавание нового феномена на входе и автоматическое создание нового класса объектов считается как минимум нетривиальной задачей []; её можно легко усложнить, добавив в условие активное обучение во время работы классификатора и временное изменение распознаваемых классов. Вторым существенным недостатком машинного обучения считается сверхчувствительность: так, распознавание лиц можно «перехитрить», надев кажущиеся безобидными очки []. В отдельных случаях можно добиться неправильной классификации фотографии путём невидимых человеку изменений: так, после кажущейся несущественной манипуляции панда на фотографии может классифицироваться как обезьяна [].

В то время, как компьютеры успешно решают «сложные» задачи вроде символических и численных вычислений и обыгрывают гроссмейстеров в шахматы, в списке нерешённых проблем много задач, отличающихся относительно простой формулировкой: классификация «неизвестных» образов без тренировки на заранее классифицированных образцах (например, распознавание яблок на фотографии, если известны только классы «вишня» и «груша»), моторика, рассуждения от «здравого смысла». В литературе этот феномен известен как «парадокс Моравека» []. Во многом это отображает человеческое восприятие: создававшиеся миллионами лет эволюцией способности, присутствующие у любого взрослого человека, кажутся само собой разумеющимися, в то время, как математические проблемы вроде нахождения кратчайшего пути на карте кажутся неестественными и их решение малоочевидным.

Перспективы применения ИИ

popsci.com / Axel Krieger

The Smart Tissue Autonomous Robot (STAR)

Ожидается, что в 2020-х годах ИИ сможет решать ещё больше задач. Ниже перечислим некоторые из них и ориентировочный прогресс научно-исследовательских и опытно-конструкторских работ.

Автономные транспортные средства

Наиболее сложной задачей для автономных транспортных средств считается участие в дорожном движении в связи с ограниченной свободой манёвра и множеством возможных ситуаций, возникающих на дороге. В 2018 г. самым высокоразвитым решением на рынке считается автопилот Audi A8, способный автономно двигаться в условиях пробок на автострадах []. В марте 2017 г. представители BMW обещали к 2021 году представить автомобиль, способный без вмешательства водителя доставлять пассажиров в место назначения [].

Военное применение

Самым перспективным направлением для военных считается возможность автоматического распознавания и сопровождения целей для роботизированных платформ, и, как следствие, автономное принятие решения на поражение []. На конец 2017 года в странах «первого эшелона» проводится ряд научно-исследовательских работ по этим темам, в первую очередь в отношении наземных, надводных и подводных комплексов.

Роботизированные хирургические процедуры

Ожидается, что хирургия, в том числе и микрохирургия, требующая точного вмешательства в тело пациента, сможет быть автоматизирована в ближайшем будущем. В 2016 г. был представлен в качестве демонстратора технологий робот STAR [], способный проводить операции на мягких тканях. При достижении успехов в распознавании образов можно ожидать роботизации всех хирургических процедур удаления тканей, что позволит сделать хирургию более доступной и снизить нагрузку на лечащий персонал.

На грани возможного: этические дилеммы и риски развития нейросетей

Нейросети могут обрабатывать огромные объемы персональных данных и это создает потенциальную угрозу для приватности. Кроме того, они используются для создания «глубоких подделок» (deep fakes), что также представляет серьезную угрозу.

Вместе с развитием нейросетей возникает вопрос об ответственности за их действия. Если программа совершит ошибку, кто будет за это отвечать? Это сложный вопрос, на который пока нет однозначного ответа.

Источник

Источник

Один из наиболее спорных вопросов, связанных с развитием нейросетей, — это возможность появления сверхинтеллекта, способного самостоятельно принимать решения и действовать вне контроля человека. Теоретически это может представлять серьезную угрозу. Однако большинство специалистов считают такой сценарий маловероятным.

Спасет ли господдержка ИИ-индустрию

Еще одна тема, которую отрасль сейчас активно обсуждает, — меры государственной поддержки. В СМИ сейчас говорится преимущественно об ИТ-сегменте, но ICT.Moscow попросил Сергея Наквасина из Аналитического центра при Правительстве РФ и Сергея Плуготаренко, директора РАЭК, рассказать о выработке антикризисных мер именно для ИИ-отрасли.

В 2022 году предусмотрены мероприятия по предоставлению грантов на разработку ИИ-решений, их продвижение и внедрение. Планируется, что к 2024 году 1,2 тыс. компаний получат господдержку на сумму свыше 17 млрд рублей.

Продолжится финансовая поддержка созданных в прошлом году шести исследовательских центров по искусственному интеллекту на базе «Сколтеха», Университета Иннополис, ИТМО, ВШЭ, МФТИ, Института системного программирования РАН. Исследовательские центры должны стать «точками» роста науки и технологии в области ИИ.

замруководителя Аналитического центра при Правительстве РФ, руководитель Центра экспертизы по реализации федерального проекта «Искусственный интеллект»

Также эксперт рассказал, что в этом году будет дорабатываться профильная образовательная программа, продолжится работа по формированию доступных ИИ-командам ведомственных датасетов, будут и дальше составляться национальные стандарты в сфере ИИ.

«МЧС в области информационных технологий», о потребности в которых говорил Сергей Карелов, по словам Сергея Плуготаренко также сейчас создаются. Однако они направлены на поддержку не только ИИ-сегмента, но всего ИТ-рынка в целом.

В конце февраля при Минцифры были созданы рабочая группа и Оперштаб, которые в кратчайшие сроки подготовили предложения по мерам поддержки для ИТ-специалистов. Второго марта президентом России был подписан и опубликован Указ о новых мерах поддержки ИТ-отрасли.

Отрасль тоже не бездействует: РАЭК при участии игроков ИТ-сегмента создала антикризисный штаб «РАЭК / Антикризис», где был разработан ряд решений по поддержке и удержанию ИТ-специалистов. Среди предлагаемых мер одной из ключевых является запуск цифровой платформы с рабочим названием «ИТ-Профсоюз», которая может стать агрегатором инструментов для ИТ-специалистов и навигатором по мерам поддержки.

директор РАЭК

В Москве в марте также была создана специальная комиссия по повышению устойчивости развития в условиях санкций. Среди семи ее штабов один направлен на поддержку в том числе сфер инноваций и информационных технологий. ИИ-направление в нем отдельно не фигурирует, однако можно предполагать, что меры поддержки будут распространяться и на этот сегмент тоже. Вскоре после этого был анонсирован запуск программы льготного кредитования и грантовой поддержки малого и среднего бизнеса, включая ИТ-предприятия. В столице были учреждены гранты на 2 млн рублей на проведение пилотных тестов инновационных разработок — прием заявок должен стартовать в апреле.

В отрасли уже есть предположения, как профильная помощь может быть использована. Адам Тураев из Cleverbots рассказал, что «при должной поддержке со стороны государства мы готовы рассмотреть работу над созданием локальных аналогов ИИ-продуктов». Что это могут быть за продукты, собеседник ICT.Moscow пока не рассказал, однако предложение может быть более чем актуально с учетом того, что на текущий момент 70-90% ИИ-решений в России, по оценкам экспертов, — зарубежные.

Основные задачи, которые ИИ-команды планируют решать с помощью предоставленных грантов, — сохранение команды и возможность разрабатывать новые решения.

Наши разработчики довольно мобильны и легко могут найти позиции за рубежом, им это интересно в силу разницы курсов. В этой связи мы увеличили зарплатный фонд минимум на 25%. Но этого недостаточно. Без существенной поддержки (буквально финансовой — в виде субсидий или грантов) нам крайне сложно сохранить команду и тем более предотвратить отток.

генеральный директор Statanly Technologies

Открытая грантовая политика государства, надеюсь, позволит компенсировать временные убытки от ухода ряда наших заказчиков с рынка в ближайшие полгода-год.

Мы планируем максимально сосредоточить свои усилия на получении государственных грантов на разработку новых отечественных продуктов с ИИ.

генеральный директор 3iTech

Впрочем, грантовая поддержка — не единственное, на что рассчитывает эксперт. По его словам, одна из задач компании на 2022 год — привлечь стратегического инвестора, что позволит увеличить стоимость компании. Иными словами: одних грантов, с высокой вероятностью, будет недостаточно: компаниям придется искать новых инвесторов, новых заказчиков и находить новое оборудование для создания и поддержания своей ИИ-инфраструктуры.

Тьюринг и игра в имитацию

Исторически считается, что первой работой в области философии искусственного интеллекта стала работа Алана Тьюринга «Вычислительные машины и интеллект», в которой он старался ответить на вопрос «Может ли машина мыслить?» . Рассмотрим то, как автор дал определение интеллекта в этой публикации.

Вместо того, чтобы водить явные дефиниции терминам «мыслить» и «машина» Тьюринг заменяет весь поставленный вопрос на некоторый другой. Для этого он вводит описание «игры в имитацию», в которой участвуют три человека: мужчина (A), женщина (B) и третья сторона, задающая вопросы (С). Цель игры для задающего вопросы — это определить пол игроков A и B, общаясь с ними по телеграфу(почте или через посыльного), то есть без прямого контакта. В свою очередь игрок A пытается ввести C в заблуждение, чтобы он сделать неверные выводы, а игрок B, наоборот помогает C сделать верное решение. В итоге первоначальный вопрос «Может ли машина мыслить?» заменяется на «Что произойдет, если в этой игре вместо А будет участвовать машина?». Сможет ли машина эффективнее чем человек обманывать C, и разгадает ли C в игроке машину по его поведению? Если сможет, то Тьюринг считает, что машина может мыслить, так как она понимает то, о чем идёт речь в беседе. Для нас интересно в этой постановке вопроса то, что здесь сопоставляется способность человека мыслить с его поведением. То есть Тьюринг задался целью спроектировать такую машину, которая сможет вести себя как человек. Для определения того, на сколько машина похожа в своём поведении на человека, он и предлагает использовать игру в имитацию.

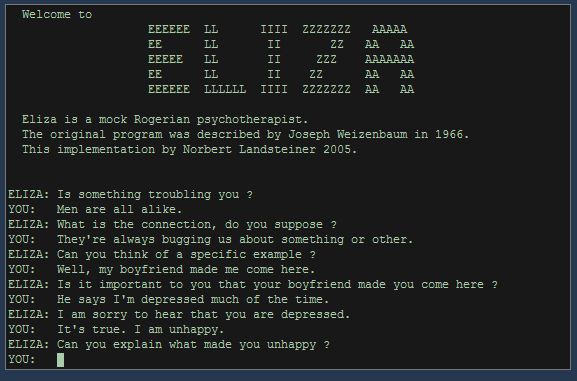

Предложенная Тьюрингом игра и вопрос представляют собой некоторую версию операционализма, в которой быть интеллектуальным, то есть обладать мыслью и способностью к размышлению, означает способность системы пройти Тест. Другими словами, у системы есть набор входов и набор выходов, человек подаёт определенные сигналы на вход и ожидает увидеть некоторый сигнал на выходе. Интеллект рассматривается как черный ящик или математическая функция с аргументами и значениями, предполагая, конечно, что сознание может быть механизировано и формально выражено через некоторую вычислимую функцию(так как иначе эту функцию не выразить в терминах полноты по Тьюрингу, что требуется для вычислимости на цифровом компьютере). Однако, такая формулировка через операционализм становится предметом затруднений. Очевидная проблема состоит в доверии к человеку-судье, к его беспристрастному, но субъективному суждению. Кроме того, как показала практика, можно создать абсолютно не интеллектуальную программу-психотерапевта, способную обмануть человека-судью.

Джозеф Вайзенбаум продемонстрировал это в созданной им программе Элиза в 1966 году. Она содержала наборы правил для разбора предложений, с помощью которых программа определяла в предложениях ключевой объект и переспрашивала судью по определенному шаблону про этот объект. Например, на фразу «Все надо мной смеются.», программа спросит «Как вы думаете, кто в большей степени?». Здесь стоит заметить, что программа не понимает смысла фразы «смеются надо мной», она просто видит ключевое слово «все» и задает совершенно общий вопрос. Если провести аналогию, то программы подобного типа работают как зеркала — они отражают обратно человеку тоже самое, что он сказал, слегка видоизменив предложения. Понимание у зеркала того, что оно отражает, отсутствует. Тем не менее это не останавливало, а даже вдохновляло, инженеров создавать такие «зеркала», задачей которых был обман человека-судьи. От части из-за обилия таких программ, к 1980-м годам наступила первая «зима» ИИ: у человечества было много программ способных пройти тест Тьюринга, но неспособных к другой интеллектуальной деятельности.

Исходя из двух проблем — субъективности судьи и возможность его обмана, единственным решением остаётся каким-то образом убрать субъективный элемент из тестирования. Если будет возможно выделить объективные факторы мышления, осмысления, намерения осмыслить, тогда будет возможно применить объективный метод тестирования. Дальнейший анализ и критику определения интеллекта по Тьюрингу можно вести через сравнение бихевиоризма и операционализма с психологизмом, как это было предложено у Неда Блока в статье «Психологизм и бихевиоризм», но мы сконцентрируемся на последствиях концепции Тьюринга.

МИФЫ, ОСНОВАННЫЕ НА ЗАБЛУЖДЕНИЯХ

Еще одно распространенное заблуждение заключается в том, что люди, сомневающиеся в ИИ и отстаивающие необходимость исследования его безопасности ‒ луддиты, не знакомые с технологией ИИ. Когда Стюарт Рассел, автор стандартного учебника по ИИ, высказал такое мнение в ходе конференции в Пуэрто Рико, аудитория рассмеялась. С этим заблуждением связано еще одно ‒ о том, что возможность поддержки исследований безопасности ИИ очень сомнительна. Но на самом деле, для внесения скромного вклада в исследования не обязательно быть уверенным в неизбежности рисков, достаточно лишь знать, что они не исключены. Подобно этому, даже минимальная возможность пожара ‒ достаточное основание для того, чтобы потратить небольшую сумму на страховку дома.

Возможно, СМИ придали дискуссиям вокруг ИИ более противоречивый образ, который не соответствует реальности. Страх, конечно, увеличивает продажи и статьи с вырванными из контекста фразами, предсказывающими неизбежный конец света, собирают большее количество просмотров, чем проработанные и сбалансированные. В результате два человека, знакомых друг с другом лишь по цитатам из интервью, могут показаться друг другу гораздо более принципиальными оппонентами, чем есть на самом деле.

К примеру, техно-скептик, знакомый с позицией Билла Гейтса по публикациям в таблоидах, может ошибочно считать, что Гейтс твердо уверен в неизбежности создания сверхразумного ИИ. Таким же образом, кто-то из про-технологичного движения может быть совершенно не знаком с позицией Эндрю Ына в целом, но помнить цитату про перенаселенный Марс и считать, что Ын не озадачен проблемой безопасности искусственного интеллекта, однако это неправда. Суть в том, что прогнозы Эндрю Ына предполагают более поздний прорыв технологий искусственного интеллекта, и в приоритет он, как правило, ставит не долгосрочные задачи, связанные с ИИ, а краткосрочные.