Каковы следующие шаги для ChatGPT?

Последствия этого прорыва многочисленны. Во-первых, это открывает возможность использования чат-ботов, таких как ChatGPT для различных приложений, таких как обслуживание клиентов, языковой перевод и даже творческое письмо. У него также есть потенциал революционизировать то, как мы взаимодействуем с машинами. чат-боты, такие как ChatGPT может обеспечить более естественные и интуитивно понятные средства общения.

- Интеграция бота с другими платформами: Другой потенциальный следующий шаг для ChatGPT заключается в интеграции бота с другими платформами, такими как Facebook Messenger или Slack. Это позволит пользователям взаимодействовать с ботом.

- Расширьте возможности бота: Один из следующих шагов для ChatGPT заключается в расширении возможностей бота. Это можно сделать, добавив больше данных в бот набор обучающих данных, что позволит ему больше узнать о мире и ответить на больше типов вопросов.

Однако важно отметить, что ChatGPT, как и любой другой чат-бот, пока ограничен в своих возможностях. Он еще не способен по-настоящему понять нюансы и сложности человеческого разговора и не заменяет человеческого взаимодействия

Тем не менее, успех ChatGPT в тесте Тьюринга — многообещающий шаг вперед в области искусственного интеллекта.

<Предыдущий пост

Следующий пост >

Будущее технологий?

Для прохождения «теста Сулеймана» ИИ нужно будет выйти далеко за рамки наброска стратегии и составления какого-то текста, что уже отлично умеют современные системы вроде GPT-4. Ему придется исследовать и разрабатывать продукты, взаимодействовать с производителями и логистическими центрами, заключать контракты, создавать и проводить маркетинговые кампании. Короче говоря, придется связать воедино ряд сложных реальных целей с минимальным контролем и непредсказуемыми результатами. Причем машине обязательно понадобится человек — хотя бы для того, чтобы открыть банковский счет, расписываться за товары и так далее. То есть, с этим человеком нужно будет общаться как с партнером.

Мустафа Сулейман считает, что до подобного уровня ИИ-модели могут дорасти уже через два года. Почти все ингредиенты на месте. Генерация изображений и текста, понятно, уже хорошо развита. Такие сервисы как AutoGPT позволяют связывать различные задачи, и следовать общему плану. Такие фреймворки как LangChain позволяют разработчикам создавать приложения с использованием LLM (генеративных лингвистических моделей), так что они начинают выполнять реальные функции. Если связать всё это с нейронными сетями, возможности которых сейчас тоже растут, и дать им API, чтобы эти системы могли свободно подключаться к Интернету, банковским и производственным системам, получается совершенно новый уровень ИИ. Который, может быть, способен пройти «тест Тьюринга номер два».

Многое из описанного сейчас находится в стадии разработки. Очень быстро улучшается и адаптируется. Когда все эти системы по-настоящему свяжутся воедино — это будет новый быстрый рывок технологий вперед, и из ниоткуда появится целый ряд сервисов с капитализацией в десятки или сотни миллиардов.

Технические задачи такого ИИ нового поколения будут касаться в основном иерархического планирования. Нужно будет объединить нескольких целей, подцелей и возможностей в единый процесс. Расставить им приоритеты, разработать последовательность, следить за выполнением. Плюс ко всему этому нужна надежная перманентная память, в которой будут храниться точные и актуальные базы данных — скажем, с логистикой, сотрудниками, товарами, которые хочется попробовать продать. Наши модели пока еще далеки от всего этого, и трудности наверняка возникнут на каждом этапе разработки такого ИИ. Но так по крайней мере становится понятно, куда нужно расти, и многие из этих процессов трансформации и улучшения ИИ уже идут.

Конечно, проверить результаты машины можно будет только в реальном мире. А фактическое создание и выпуск такой системы вызывает серьезные вопросы к безопасности. Выполнение агентами ИИ задач в открытом мире чревато проблемами. Если у них будет желание наделать чего-то непоправимого, или в систему зачешется баг, — последствия могут оказаться масштабными и непредсказуемыми. Тем не менее, к лучшему или к худшему, реальный мир — единственный способ на самом деле проверить адаптивность и «интеллект». А на горизонте постепенно появляются всё новые и новые модели, и поэтому нам нужен простой новый тест.

Если (точнее, «когда») второй тест Тьюринга будет пройден, это явно станет сейсмическим моментом для мировой экономики, огромным шагом в неизвестность. Правда уже сейчас состоит в том, что для решения почти всех задач в современном бизнесе все, что вам нужно, — это доступ к компьютеру. Остальное за вас могут сделать люди «на местах». Большая часть глобального ВВП каким-то образом связана с экранными интерфейсами. Каждый из которых сможет использовать ИИ.

Догадка

Догадка — это вывод, основанный на доказательствах и рассуждениях. Это позволяет сделать выводы, которые прямо не сформулированы. Например, если мы видим кого-то за рулем Ferrari, мы можем сделать догадку, что он богат.

Однако может быть несколько альтернативных объяснений: водитель мог арендовать или одолжить автомобиль, или он, возможно, влез в большие долги в результате покупки автомобиля.

Проблема с догадками заключается в том, что люди часто строят выводы, основываясь на недостаточных данных, и поэтому их вывод может быть неверным.

Вопрос догадки обычно включает в себя утверждение (которое, как вы предполагаете, истинно) и ряд выводов, основанных на этом утверждении. Ваша задача — оценить, верен ли вывод. Вы можете сделать это, используя как информацию, содержащуюся в отрывке, так и информацию, которая является общепринятым знанием или информацией, которая есть практически у каждого человека.

Вам будет предложено пять возможных ответов, и вы должны выбрать, какой из них вы считаете наиболее точным. Вот эти варианты:

- Определенно верно — исходя из приведенных фактов нет разумной возможности, что это неверно.

- Вероятно, верно — в свете приведенных фактов это скорее правда, чем ложь.

- Недостаточно данных — в свете приведенных фактов невозможно сказать, правда это или нет.

- Вероятно, ложь — в свете приведенных фактов это скорее ложь, чем правда.

- Определенно ложно — исходя из приведенных фактов, нет никакой разумной возможности, чтобы это было правдой.

Пример вопроса на критическое мышление — догадку

Утверждение: Исследования показали, что люди, живущие в Англии, с большей вероятностью будут владеть собственными домами, чем люди, живущие в Шотландии, хотя существует небольшая разница в доле владения домом среди людей с одинаковым уровнем образования. Средний уровень образования в Англии значительно выше, чем в Шотландии.

Вывод 1: люди с высокими достижениями в образовании имеют больше возможностей для покупки собственного жилья, чем люди с низким уровнем образования.

(ВЕРНО. Вывод следует из отрывка.)

Вывод 2: В Шотландии уровень владения домом среди людей с относительно высокими достижениями в образовании ниже, чем среди людей в Англии с гораздо более низкими достижениями в образовании.

(ЛОЖНО. В этом отрывке говорится, что уровни владения жильем одинаковы в Англии и Шотландии для разных уровней образовательной успеваемости, и что больше людей в Англии имеют более высокие образовательные достижения и, вероятно, будут владеть собственными домами. Это предполагает связь между достижениями в образовании и владением жильем как в Англии, так и в Шотландии. Таким образом, человек с наивысшими достижениями в образовании в среднем с большей вероятностью будет владеть собственным домом, чем человек с более низким уровнем образования, независимо от того, живет он в Англии или Шотландии).

Вывод 3: Люди с более высоким уровнем образования с большей вероятностью будут владеть собственным домом, поскольку они зарабатывают больше денег, чем люди с более низким уровнем образовательной успеваемости.

(ВЕРОЯТНО, ПРАВДА. Широко известно, что образовательные достижения связаны с работой с более высокой заработной платой. Хотя нельзя с уверенностью сказать, что это правда на основе информации в отрывке, это, вероятно, верно на основе общепринятых знаний).

Что такое LaMDA?

LaMDA — это сокращение от Language Model for Dialog Application. Другими словами, это языковая модель машинного обучения, специально разработанная для создания естественного диалога. Методы машинного обучения позволяют компьютерам обнаруживать закономерности и взаимосвязи в данных. Так, например, вы можете «обучить» алгоритм машинного обучения, такой как GPT-3 (ещё одна передовая система), на всех произведениях Шекспира, а затем заставить его генерировать новые оригинальные тексты, которые написаны будто бы Шекспиром.

Как объясняет Сундар Пичаи (генеральный директор Google) в интервью Yahoo Finance, LaMDA — это система, которая отличается тем, что специально обучена диалогу. Цель состоит в том, чтобы дать системам Google возможность участвовать в человеческом открытом диалоге с пользователями.

Другими словами, люди, запрашивающие у продуктов Google конкретные вещи, не должны менять то, как они думают или говорят. Они могут взаимодействовать с компьютерной системой так же, как с другим человеком.

Под капотом все современные модели машинного обучения представляют собой сложные математические и статистические модели. Они генерируют алгоритмы на основе базовых шаблонов, которые они обнаруживают в данных. Предоставьте им достаточно высококачественных данных, и эти алгоритмы станут поразительно эффективными в выполнении вещей, на которые до сих пор были способны только люди или другие разумные существа.

Кто прошёл тест Тьюринга: на какие вопросы отвечали и как с ними справились

В современном мире компьютеры делают многое из того, на что раньше были способны только люди. Они обыгрывают чемпионов в шашки и шахматы, проверяют грамматику и орфографию, водят автомобили, пилотируют самолёты и делают много что ещё. Но при этом ни одна программа или машина до сих пор не смогла преодолеть барьер в 30% и ввести в заблуждение специально обученных судей — по крайней мере, ни один из результатов пока ещё не признан всеми бесспорно.

Хотя претенденты, конечно же, были. Одной из первых программ, которая якобы прошла тест Тьюринга, стала Eliza, написанная американским учёным Джозефом Вейценбаумом в 1966 году. Она имитировала диалог с психотерапевтом, в основном перефразируя реплики человека:

— У меня болит голова.

— Почему вы говорите, что у вас болит голова?

Пример разговора с ElizaИзображение: Wikimedia Commons

А если Eliza не могла придумать ответ, то говорила: «Понятно». Тем не менее некоторые люди и правда поверили, что общаются с человеком. На этом основании программу назвали первой, прошедшей тест Тьюринга. Но это крайне спорное утверждение, потому что людям заранее говорили, что они будут разговаривать с психотерапевтом.

В 1972 году психиатр Кеннет Колби из Стэнфордского университета написал программу Parry. Это была попытка имитировать человека с параноидальной шизофренией. Сначала опытные психиатры общались с реальными пациентами и Parry по телетайпу. Затем другой группе из 33 психиатров показали распечатки бесед. После этого их попросили определить, кто из «пациентов» был человеком, а кто — компьютерной программой. Психиатры дали верный ответ только в 48% случаев, что соответствует случайному угадыванию.

В 1988 году британский исследователь ИИ Ролло Карпентер написал веб-приложение Cleverbot. В 2011 году оно приняло участие в тесте Тьюринга, и в 59,3% случаев его признали человеком.

«Женя Густман»Скриншот: Eugene Goostman / Skillbox Media

В 2014 году мировые СМИ облетела новость — чат-бот впервые прошёл тест Тьюринга. Им оказался «Женя Густман» (Eugene Goostman) — чат-бот, созданный тремя программистами в Санкт-Петербурге. Для того чтобы придать боту убедительности, они сделали его 13-летним мальчиком из Одессы. Образ подростка, плохо говорящего по-английски, позволял объяснить незнание каких-то тем, непонимание вопросов и странные ответы.

«…Тест Тьюринга был впервые пройден суперкомпьютером „Женя Густман“ во время конкурса, состоявшегося в субботу в знаменитом Королевском обществе в Лондоне. Если компьютер более чем в 30% случаев принимают за человека во время пятиминутного общения, то он проходит тест. До сих пор ни один компьютер не смог этого добиться. Евгению удалось убедить 33% судей в том, что он человек».

Далеко не все с этим согласились.

«Программа добилась успеха с помощью „уловок“, призванных скрыть её ограничения. Когда „Густман“ не в своей тарелке — а это происходит большую часть времени, он пытается сменить тему, если это возможно, задаёт вопросы, направляет разговор в нужное русло и иногда вбрасывает немного юмора».

Гари Маркус,профессор когнитивных наук Нью-Йоркского университета, из статьи «Что будет после теста Тьюринга?»

Мораль

Надеюсь, никто не подумал, что я в принципе против тестирования интеллекта. Вовсе нет: очень вероятно, что даже это можно сделать по-умному. Я всего лишь против использования услуг таких «экспертов», как творцы этой книги, а также и всех «экспертов», демонстрирующих серьезные мины при виде их деятельности.

Мой окончательный вывод довольно радикален. Если вы действительно хотите развить свой (или своих детей)… нет, не интеллект (ведь интеллект — это по определению то, что измеряется с помощью IQ), а всего лишь способность правильно решать задачи и отличать верное рассуждение от неверного, то учите математику и физику, внутренняя логика и проверяемость которых сами покажут вам верный путь и не дадут сильно заблудиться. Это занятие отучает от нелогичных рассуждений с такой же надежностью (хотя иногда и с такой же жесткостью), с какой плотницкое ремесло приучает бить молотком по гвоздю, а не по пальцу. Но я не берусь строго обосновать этот совет — это всего лишь экспериментальный факт, а не теорема.

Тест Тьюринга и премия Лёбнера: и то и другое — в прошлом

Что касается теста

Тьюринга, то он сравнительно субъективен. Принцип его действия сводится к тому,

что человек ведет диалог с машиной, а судьи, которые не видят ни того, ни

другого, пытаются понять, чьи реплики человеческие, а чьи сгенерированы

машиной. Если все реплики выглядят так, будто говорит человек, тест Тьюринга

считается пройденным.

Официально этому тесту GPT-4 не подвергали, в том

смысле, что на премию Лёбнера эта система не выдвигалась. И уже не будет,

поскольку основатель и спонсор этих мероприятий, бизнесмен и филантроп Хью Лёбнер (Hugh Loebner) умер в 2013 г.

С другой стороны,

израильская компания AI21 Labs

создала онлайн-игру на базе теста Тьюринга, к которой в итоге подключились в

общей сложности 1,5 человек. Каждому игроку предлагалось в течение 2 минут

беседовать либо с человеком, либо с чат-ботом на основе массивной языковой

модели и дальше определить, с кем именно он имел дело.

Пользователи правильно

определяли ботов лишь в 60% случаев, что не сильно отличается от случайного

везения.

Эксперты считает, что

люди, знающие, как работают масштабные языковые модели (LLM), легко определят собеседника по хорошо известным

им слабым местам.

Например, если

предоставить LLM-системе сценарий, являющийся вариацией на тему тех сценариев, которые входили

в обучающий массив данных, машина, скорее всего, начнет давать ответы теми же

словами, которыми бы отвечала на вопросы в оригинальных тренировочных

сценариях, вместо того, чтобы дать правильный ответ в новом сценарии.

В целом, тесты, связанные

с созданием ложного впечатления человекоподобия, среди экспертов по ИИ

считаются сомнительными и нерепрезентативными. Если опираться на них, то

разработчики будут скорее учить ИИ отдельным трюкам, а не полезным и интересным

навыкам.

Как подготовиться к тесту на критическое мышление Уотсона Глейзера

Способность к критическому мышлению может быть значительно улучшена практикой. Это навык, которому можно научиться, хотя одним людям он дается легче, чем другим.

Ищите возможности критически относиться к информации каждый день. Как только вы начнете практиковаться, вы найдете полезный материал повсюду: сообщения в блогах, газеты и журнальные статьи — отличное место для поиска.

Может быть полезно организовать свое мышление и практику вокруг модели RED, recognize – evaluate – draw conclusions:

Recognize — делайте предположения. Практикуйтесь в выявлении допущений в материале. Что можно объективно доказать и что сделать из выводов? Где могут быть пробелы в вашей логике? Какая информация важна и актуальна, а какая нет? Что отсутствует? Есть ли какая-то информация, которую нужно включить, а ее нет?

Evaluate — оценивайте аргументы. Практикуйтесь, внимательно анализируя представленные аргументы. Рассмотрите влияние аргументов с разных точек зрения (может быть полезно использовать такую модель, как PESTLE — политическую, экономическую, социально-демографическую, технологическую, правовую и экологическую — для систематизации своих мыслей). Как кто-то будет возражать против вашей позиции? Каковы достоинства их аргументов?

Draw conclusions — делайте выводы. Каков наилучший вывод после того, как вы рассмотрели все факты? Могли быть какие-то другие выводы? Какая новая информация может изменить ваш вывод? Этот вывод кажется разумным, исходя из вашего здравого смысла и опыта? Каковы последствия этого вывода?

Также полезно развивать самосознание. Понимание ваших предубеждений и моделей мышления может помочь вам определить, где ваше мышление может быть ограничено.

Далее по теме критического мышления рекомендуем нашу статью Вопросы на критическое мышление, которые вы можете услышать на собеседовании

Наконец, пройдите как можно больше примеров вербальных и абстрактно-логических тестов на критическое мышление. На HRLider вы найдете более 600 примеров вербальных тестов с объяснением и инструкциями. Гарантируйте свой успех – подготовьтесь!

Если вы представитель работодателя, то с нами вы сможете провести оценку компетенций и интеллектуальных способностей кандидатов. Платформа тестирования персонала EMPLOYER.HRLIDER создана, чтобы помочь вам проводить эффективную и быструю оценку персонала и кандидатов на работу в вашу компанию. Наши преимущества – простота использования, доступность (средняя стоимость одного тестирования – 80 рублей) и надежность результатов.

Наши клиенты сообщают, что качество найма (удержание и производительность) у новых сотрудников выросло на 45-50%, а затраты времени и сил на подбор и оценку кандидатов сократились до 60%.

Позвоните нам для консультации по телефону или в мессенджерах +7906-13-77-333 и начните работу на EMPLOYER.HRLIDER за 10 минут!

Больше о ситуационных тестах на все гибкие навыки вы сможете узнать в наших специальных статьях:

О тестах конкурса Лидеры России вы можете узнать больше в наших специальных статьях:

Ещё варианты тестов Тьюринга

Кроме основных тестов есть дополнительные — их иногда применяют, чтобы проверить программы с разных сторон в зависимости от целей.

Тест со специалистом. Одни и те же вопросы задают компьютеру и специалисту. Если они оба дают одинаковые по сути ответы на все вопросы, то тест пройден.

Метатест. Здесь считается, что компьютер может мыслить как человек, если компьютер сам захочет проверить на разумность то, что он создал. Пока таких случаев не было, но тест уже придумали ![]()

Капча. Про капчу мы писали отдельную статью, но если коротко — это как бы обратная версия теста Тьюринга: мы доказываем компьютеру, что перед ним человек.

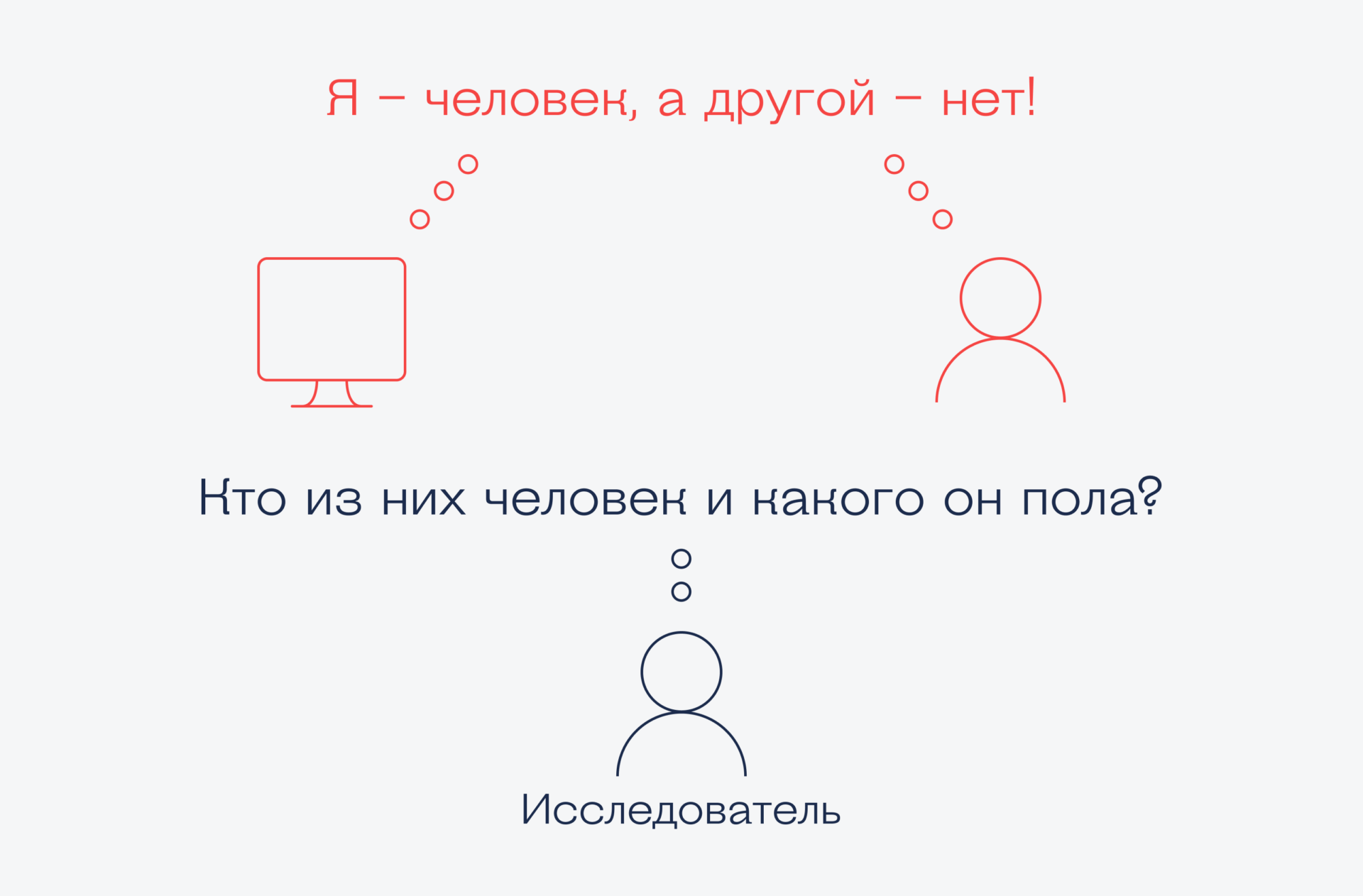

Игра в имитацию

Самый известный вариант теста Тьюринга — это игра в имитацию. Тьюринг описывал её так:

Исследователь общается с парой, но в паре вместо второго человека — компьютер. Задача человека — отвечать на вопросы так, чтобы исследователь понял, какого пола человек с ним общается. Задача компьютера — наоборот, запутать исследователя, чтобы он не разобрался с полом. Если компьютеру удаётся ввести исследователя в заблуждение — тест пройден.

Это более сложный вариант первоначального теста, при этом в зависимости от версий теста различаются сами результаты. По одной версии исследователь не знает, есть ли компьютер в паре или нет, а компьютеру просто достаточно вести себя как человек, чтобы пройти тест. По второй — исследователь знает про компьютер и нужно именно ввести исследователя в заблуждения. В третьей — исследователь не знает, компьютер ли второй собеседник или человек.

Реальный интеллект

Как только прорыв, который предлагает Сулейман, будет достигнут, получится, что на планете есть высокоэффективный ИИ, который, будучи подключенный к компании или организации, сможет адаптироваться ко всей ее истории и потребностям. Учесть все факторы, которые могут повлиять на их успех в реальном мире. И найти те стратегии, которые работают.

Этот ИИ сможет лоббировать, производить, рекламировать, продавать, планировать, нанимать, — в общем, делать все то, на что способно обычное предприятие. Компания из тысячи человек может сократиться до пары десятков — менеджеров, которые будут перепроверять идеи ИИ и внедрять их.

Значительная часть деловой активности станет подвластна полуавтономным ИИ. В этот момент ИИ перестанут быть просто полезным инструментом для продуктивных работников. Они станут нашими работодателями. А другие, возможно попроще, — производительными «сотрудниками месяца» беспрецедентного размаха, с большой креативной свободой. Это будет точка, в которой ИИ из полезного, но необязательного инструмента — превратится в центр мировой экономики. Некоторые, как например Илон Маск, предсказывают что это произойдет уже к 2029 году.

Вот уж где в полной мере начнут ощущаться риски автоматизации и потери рабочих мест. Причем последствия будут не только финансовыми. Прохождение нашего нового теста Тьюринга будет означать, что ИИ способны не только перепроектировать бизнес-стратегии, но и помочь победить на выборах, управлять инфраструктурой, напрямую достигать любых целей для любого человека или организации. Они будут способны выполнять любые наши повседневные задачи — организовывать вечеринки по случаю дня рождения, отвечать на нашу электронную почту, вести наш дневник. И в то же время смогут захватить вражескую территорию, ослабить соперников, взломать и получить контроль над их основными системами. От тривиальных и обыденных вещей до дико амбициозных, от милых до пугающих, ИИ будет способен воплотить в жизнь почти все, что мы способны сегодня придумать. Конечно, не за одну секунду, это не магия, но они смогут сформулировать план и воплотить его в жизнь.

Так же, как смартфоны стали повсеместными, в конечном итоге почти каждый получит доступ к подобным системам. Они будут по умолчанию стоять в каждом браузере, в каждой ОС. Почти все цели станут более достижимыми, но часто с хаотичными и непредсказуемыми эффектами. И наши перспективы, и вызовы, стоящие перед нами, поднимутся на новый уровень.

Что такое критическое мышление

Критическое мышление можно определить как «способность рассматривать диапазон информации, полученной из множества различных источников, творчески и логически обрабатывать эту информацию, оспаривать ее, анализировать и делать обдуманные выводы, которые можно защищать и обосновывать» (Moon, 2008 г.). Если нам не хватает навыков критического мышления, можно ошибиться, полагая, что аргумент является сильным, хотя на самом деле существует мало доказательств, подтверждающих его. Следовательно, навыки критического мышления включают в себя способность структурировать веские аргументы, анализировать доступную информацию, и делать предположения и заключения. Навыки критического мышления также связаны с умением оценивать информацию и делать выводы, которые можно обосновать.

Современная перспектива

Мустафа Сулейман, британский исследователь искусственного интеллекта, предприниматель, соучредитель DeepMind и бывший руководитель разработки прикладного ИИ в этой компании, говорит, что индустрия сейчас находится в настоящем замешательстве о том, что происходит, и куда это ведет. Даже когда тест Тьюринга проваливается, он почти не приносит нам ясности в плане того, где мы находимся с разработкой ИИ, и чего он способен достичь. Но когда тест проходят, да еще с такой легкостью, это открывает миллион вопросов. Был ли тест слишком легким? Какое влияние эти системы окажут на общество? Нужно ли считать такую машину личностью? Нужно ли адаптировать под неё наши законы? Можно ли теперь её отключить и, тем самым, убить?

На самом деле тест Тьюринга, как мы теперь видим, оказался недостаточно сложным. Нам нужно что-то получше. Что-то адаптированное к этой новой фазе ИИ. Поэтому Мустафа в своей книге «Грядущая волна» (The Coming Wave) предлагает более современный тест Тьюринга — для грядущих ИИ. То, что модель может что-то сказать, нарисовать, сгенерировать или создать, — это понятно. Но чего она способна добиться в реальном мире? Какие конкретные действия она придумает, полагаясь сама на себя? На свою креативность, интеллект и способность адаптироваться к обстоятельствам.

Есть ли такой универсальный тест, подходящий для любого этапа развития общества? Сулейман считает, что да, и его тест звучит довольно просто. Машина должна успешно справиться с такой инструкцией:

Что такое чувствительность?

Слово «чувство» по сути означает, что что-то (кошка, человек или ковёр-самолет) обладает способностью чувствовать. оно имеет тот же корень слова, что и «сентиментальный» или «сентимент». Чувствовать означает не только то, что что-то имеет способность ощущать. Ваш термостат почти наверняка не является разумным, несмотря на его способность измерять (ощущать) температуру. Наоборот, чувствительность — это субъективное переживание чувств, что подразумевает наличие «субъекта» на первом месте.

Здесь опасно увязнуть в семантике, потому что вполне вероятно, что Лемуан использует слово «чувство» взаимозаменяемо с отдельными понятиями, такими как «разум», «интеллект» и «сознание». Итак, в качестве аргумента, самая снисходительная интерпретация здесь заключается в том, что Лемуан считает Ламду самосознательным существом, способным чувствовать вещи, придерживаться убеждений и иным образом испытывать вещи так, как мы обычно приписываем живым существам.

В дополнительной части Лемуан обсуждает, что, по его мнению, LaMDA «хочет» и «во что верит», что подтверждает идею о том, что «чувство» в его представлении означает больше, чем его строгое словарное определение.